¿Recuerdas a los jugadores que tenían a cientos de adolescentes jugando a Axie Infinity para que ganaran Pociones Mágicas de Amor?

Sí, eso fue hace 4 años.

Ahora puedes entrenar y poner en marcha a 100 operadores de códec autónomos para que jueguen por ti

... y monetizarlo y venderlo a otros

✅ IA x Robótica

La narrativa de AI x Robotics se está calentando de verdad con los modelos VLA

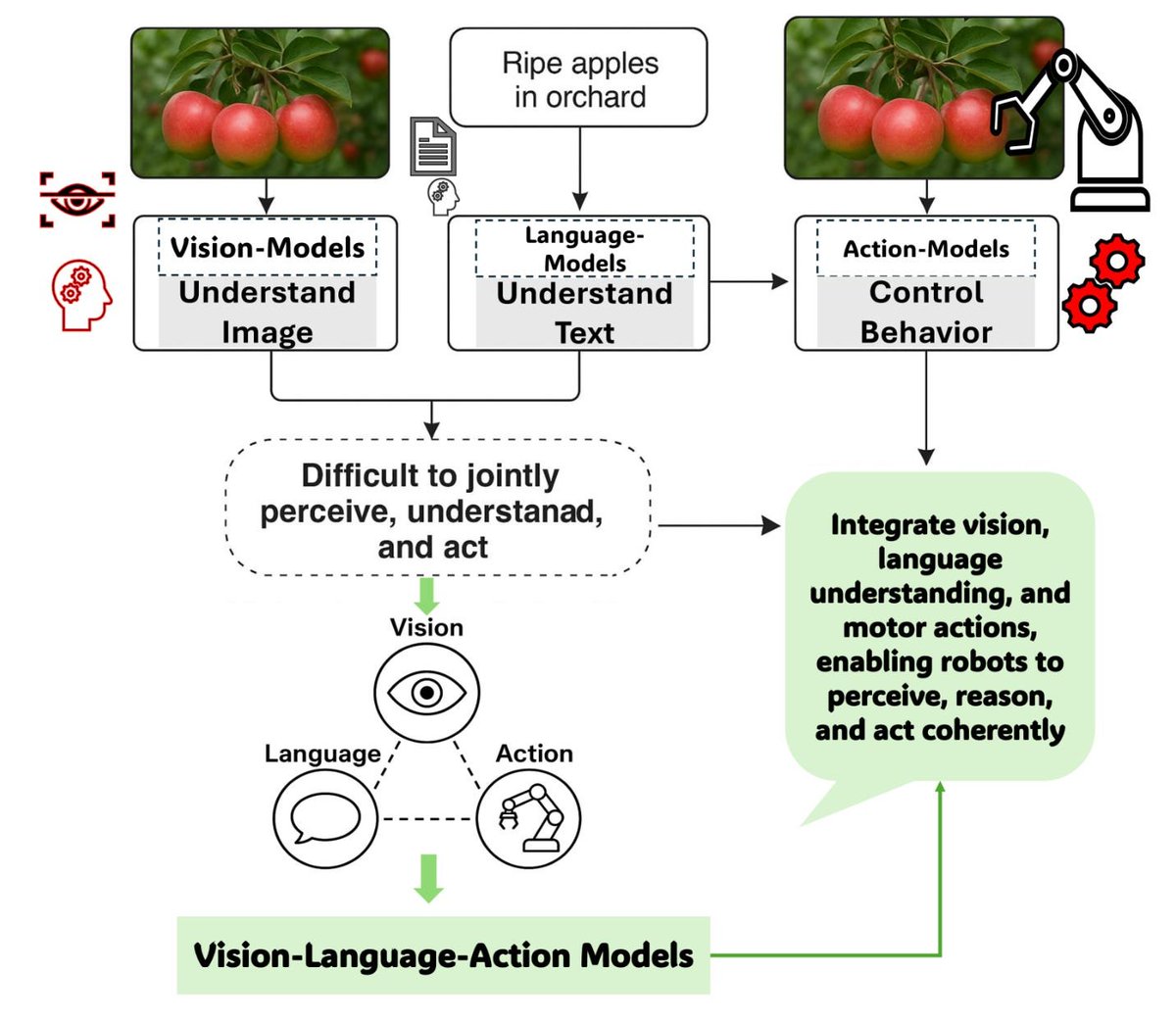

En esta etapa del ecosistema de IA, la mayoría de los protocolos y agentes utilizan motores LLM basados en texto o capturas de pantalla estáticas para interpretar los datos

Pero recuerde que la mayor parte del mundo real no tiene acceso a la API, necesita visión, decisiones y acciones. El mundo real debe verse en píxeles y aquí es donde entran en juego los modelos VLA

@Codecopenflow permite la automatización del software y la robótica a través de la visión utilizando una pila tecnológica construida desde cero

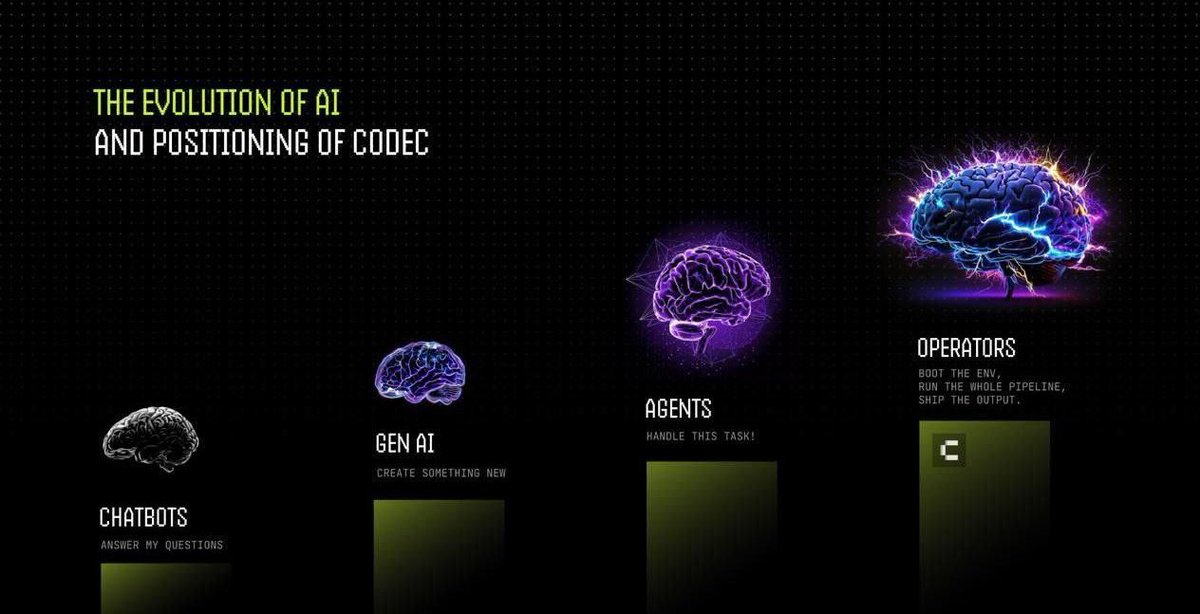

✅ Operadores de CODEC

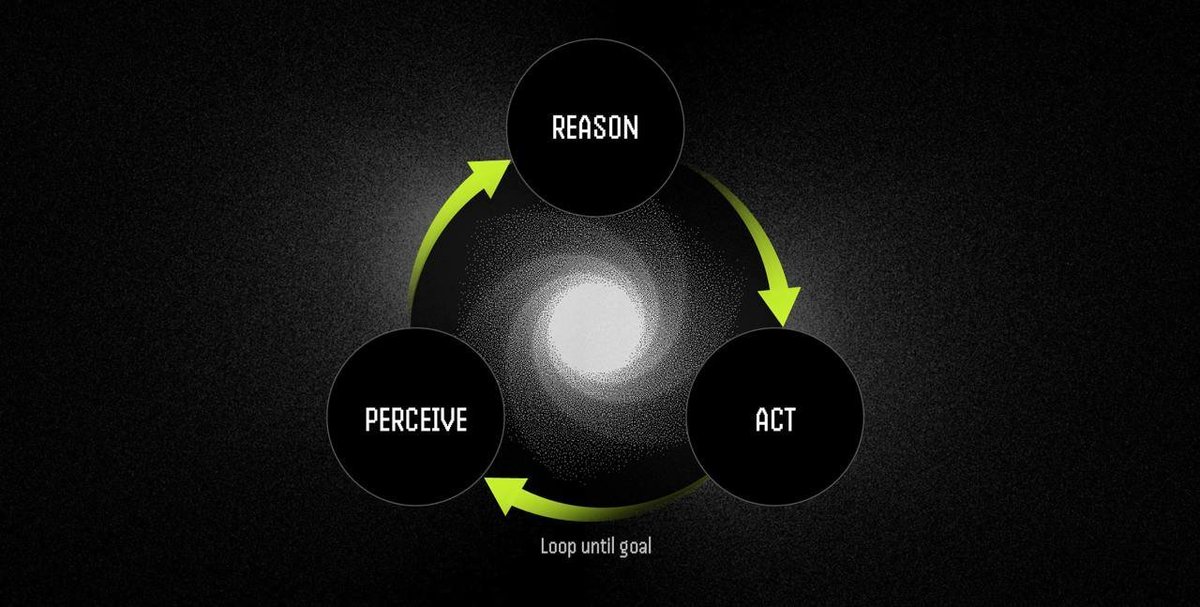

Los operadores son agentes de software autónomos que pueden realizar tareas a través de un ciclo de percepción-razonamiento-acción. La capacidad de ver la pantalla (o las imágenes de la cámara o los datos del sensor) les permite tomar decisiones que los LLM no podrían hacer

• Percepción: Captura capturas de pantalla, imágenes de cámara o datos de sensores

• Razonamiento: Procesa observaciones e instrucciones utilizando modelos de visión-lenguaje

• Acción: Ejecuta decisiones a través de interacciones de interfaz de usuario o control de hardware

En un bucle continuo

Los operadores pueden ejecutarse en servidores bare-metal, máquinas virtuales (en cualquier sistema operativo) o incluso en robots.

Cada operador obtiene automáticamente una máquina de cómputo dedicada (máquina virtual aislada o instancia de contenedor) y puede protegerse mediante TEE (aislamiento a nivel de hardware) para código y datos confidenciales.

✅ Capa de inteligencia de IA

Los operadores pueden configurarse para utilizar uno o más modelos (LLM o VLA) combinados como su "cerebro"

Por ejemplo, emparejar el modelo de lenguaje de bajo coste Mixtral-8×7B con el modelo de visión CogVLM de código abierto permite a los operadores leer el texto en pantalla e interpretar las transmisiones en directo de la pantalla o de la cámara, todo ello a una fracción del coste de GPT-4.

Un modelo VLA (Visión-Lenguaje-Acción) permite al agente interpretar la entrada visual y luego decidir una acción en función de lo que ve

✅ Casos de uso

🔹 Automatización de escritorio

Puede automatizar tareas repetitivas de oficina mediante el control de las interfaces gráficas de usuario. Como rellenar hojas de cálculo, actualizar calendarios u otras tareas que requieran interacción con la interfaz gráfica de usuario

Puede manejar las actualizaciones de la interfaz de usuario, ya que realmente puede ver lo que está haciendo

🔹 Agentes de juego

Los operadores pueden controlar jugadores o probar videojuegos. Los agentes están transmitiendo la pantalla y pueden realizar acciones basadas en lo que ven enviando comandos de teclado o mouse al juego.

Se puede utilizar para pruebas de control de calidad, o incluso oponentes NPC avanzados o automatización de juegos web3

🔹 Robótica

Los operadores pueden controlar robots físicos. La capa de la máquina se conectará al hardware de un robot con sensores y actuadores, y el agente puede enviar comandos para mover un brazo o navegar.

Por ejemplo, podría capturar una imagen de cámara de objetos que se mueven en una cinta transportadora y realizar acciones basadas en el movimiento. Si hay un obstáculo en el camino, el operador puede verlo y controlar el robot para evitarlo

✅ Recopilación de datos y barandillas de seguridad en cadena

Al llevar la información de los operadores onchain a Solana, pueden ofrecer registros de acciones inmutables de todas las acciones realizadas

En el futuro, podemos ver un punto en el que las empresas de robótica tendrían que apostar un token para garantizar que sus operadores no hagan que un robot haga contacto físico con un humano a través de una determinada fuerza. Si lo incumplen, serían recortados por una parte del token apostado (como EigenLayer / Symbiotic restaking)

✅ Entorno de formación para la robótica

Con Codec, los modelos virtuales no entrenados se pueden implementar en un campo de entrenamiento dinámico y de alta fidelidad, sin necesidad de un robot físico.

Simule, entrene y perfeccione comportamientos complejos a escala de la nube y, a continuación, transfiera esas políticas a hardware real con confianza.

Los entornos de formación se pueden poner en marcha rápidamente para todo tipo de operadores (software, juegos o robótica)

✅ SDK de códec

Se ha desarrollado un SDK y una API completos para que los desarrolladores puedan implementar sus operadores fácilmente

✅ Mercado de operadores

Los operadores pueden (en el futuro) venderse en un mercado personalizado.

Habrá una división de ingresos para que pueda enviar y monetizar su operador de VLA, lo que significa que si capacita a operadores efectivos, podría tener flujos de ingresos adicionales

✅ Reflexiones finales

Creo que veremos desarrollos masivos en el campo de VLA en el próximo año. Hemos visto lo rápido que se desarrollan los LLM, hace solo unos años que se lanzó GPT-1. Es muy probable que la robótica y los modelos de visión se conviertan en una narrativa candente en algún momento de este ciclo, y me gusta que me posicionen temprano

Ah, ¿y mencioné que los cofundadores son de los juegos 👀 Hugging Face y Elixir

Nota: Slappjakke tiene grandes bolsas de $CODEC, y esta es una de esas veces que me volví aún más optimista mientras escribía este hilo y agregué aún más

Como siempre, esto no es un consejo financiero y es una inversión de alto riesgo, así que haz tu propia investigación.

Mostrar original

8.86 K

105

El contenido al que estás accediendo se ofrece por terceros. A menos que se indique lo contrario, OKX no es autor de la información y no reclama ningún derecho de autor sobre los materiales. El contenido solo se proporciona con fines informativos y no representa las opiniones de OKX. No pretende ser un respaldo de ningún tipo y no debe ser considerado como un consejo de inversión o una solicitud para comprar o vender activos digitales. En la medida en que la IA generativa se utiliza para proporcionar resúmenes u otra información, dicho contenido generado por IA puede ser inexacto o incoherente. Lee el artículo enlazado para más detalles e información. OKX no es responsable del contenido alojado en sitios de terceros. Los holdings de activos digitales, incluidos stablecoins y NFT, suponen un alto nivel de riesgo y pueden fluctuar mucho. Debes considerar cuidadosamente si el trading o holding de activos digitales es adecuado para ti según tu situación financiera.